Ce qui se passe à l’intérieur de la machine : le Flux Console Brut expliqué.

La plupart des systèmes IA vous donnent une réponse. Ils cachent tout le reste.

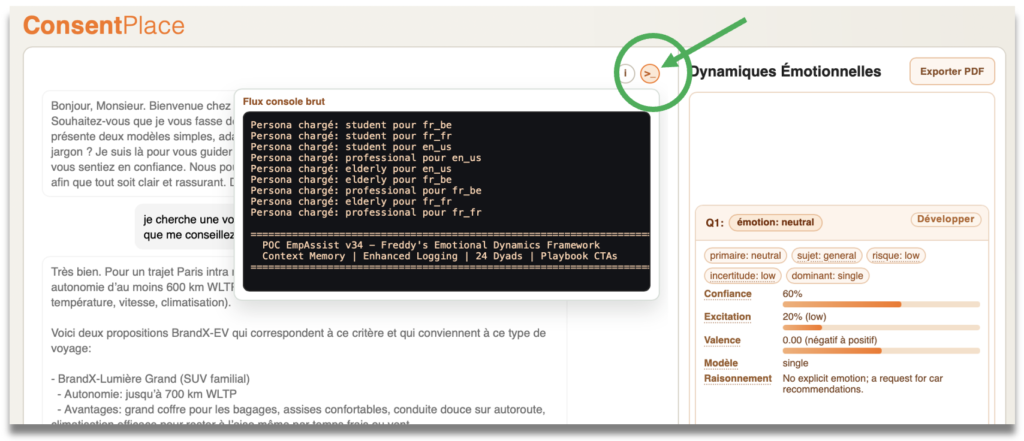

ConsentPlace vous montre la totalité du processus. Le Flux Console Brut — accessible directement dans la démo en ligne — révèle chaque décision prise par le moteur de Dynamiques Émotionnelles, en temps réel, au fil de la conversation.

Cet article vous explique ce que vous voyez, et pourquoi cela change tout.

Une fenêtre sur le moteur

Dans la démo ConsentPlace, un petit bouton >_ est visible en haut à droite de l’interface. Cliquez dessus, et un terminal s’ouvre : le Flux Console Brut.

Ce n’est pas un fichier de log. Ce n’est pas un panneau de débogage réservé aux ingénieurs. C’est un flux en temps réel de chaque signal traité par le moteur de Dynamiques Émotionnelles : chargement des personas, détection des émotions, formation des dyades, routage des playbooks, adaptation du ton — tout, rendu visible, à mesure que chaque message est échangé.

C’est, en substance, le système nerveux de la conversation rendu visible.

Chargement des personas — avant le premier mot

Le flux commence avant que l’utilisateur n’ait tapé quoi que ce soit. Le moteur charge en parallèle tous les profils possibles pour toutes les configurations de langue et de pays — une étape préparatoire qui garantit une latence nulle au démarrage de la conversation.

Persona chargé: student pour fr_fr

Persona chargé: student pour en_us

Persona chargé: professional pour en_us

Persona chargé: elderly pour en_us

Persona chargé: elderly pour fr_be

Persona chargé: professional pour fr_be

Persona chargé: elderly pour fr_fr

Persona chargé: professional pour fr_fr

====================================================================== POC EmpAssist v34 – Freddy’s Emotional Dynamics Framework

Context Memory | Enhanced Logging | 24 Dyads | Playbook CTAs ======================================================================

Une fois la configuration sélectionnée — dans cette démo : langue française, France, persona elderly — le moteur verrouille le contexte :

Style: lent, clair, phrases complètes, vouvoiement à la Parisienne, mode Versaille

Contexte: Venu sur le site après avoir vu une publicité sur les voitures électriques.

Émotion neutre — Le moteur en mode écoute

Après le premier message de l’utilisateur, le flux révèle l’analyse émotionnelle complète. Dans ce cas précis, l’utilisateur pose une question fonctionnelle sur l’autonomie. Le moteur lit : aucune émotion marquée, encore.

{

« primary_emotion »: « neutral »,

« secondary_emotion »: null,

« dyad_name »: null,

« dynamic_pattern »: « single »,

« valence »: 0.0,

« arousal »: 0.2,

« uncertainty »: « low »

}

— Emotion Blend v32: neutral (single) [+0.0/]

— Dynamics Adaptation v34 (cached): tone=neutral, pacing=maintain

— Mode: Chitchat

Formation de la dyade Espoir — Anticipation + Confiance

Au message suivant, quelque chose change. L’utilisateur pose une question sur les sensations de conduite — une comparaison avec une Porsche 911. Le ton devient personnel, aspirationnel. Le moteur le lit immédiatement.

{

« primary_emotion »: « anticipation »,

« secondary_emotion »: « trust »,

« dyad_name »: « hope »,

« dyad_type »: « secondary »,

« dynamic_pattern »: « reinforcement »,

« valence »: 0.5,

« arousal »: 0.4

}

— Playbook dyad routing: hope (secondary)

— Emotion Blend v32: anticipation+trust=hope (reinforcement) [+0.5/]

— Dynamics Adaptation v34 (cached): tone=more_enthusiastic, pacing=accelerate

— Mode: Chitchat

Le pic d’Optimisme — et le déclenchement du consentement

C’est ici que cette démo révèle quelque chose que peu de systèmes IA montrent jamais : le moment exact où le moteur décide qu’il est approprié d’agir — et comment il collecte le consentement avant de le faire.

L’utilisateur exprime son enthousiasme pour un essai. Joie + Anticipation se combinent. La dyade primaire Optimisme se forme. Valence : +0.8. Et le moteur enclenche une séquence qu’aucun NPS ne pourrait déclencher.

{

« primary_emotion »: « joy »,

« secondary_emotion »: « anticipation »,

« dyad_name »: « optimism »,

« dyad_type »: « primary »,

« dynamic_pattern »: « reinforcement »,

« valence »: 0.8,

« arousal »: 0.65

}

— Playbook dyad routing: optimism (primary)

— Emotion Blend v32: joy+anticipation=optimism (reinforcement) [+0.8/]

— Dynamics Analysis v32: dominant=reinforcement, trend=stabilizing

— Dynamics Adaptation v34 (cached): tone=more_enthusiastic, pacing=accelerate

— Analyse opportunité consentement: OUI

— Mode: Initialisation d’appel de fonction

— Fonction demandée : find_garages

— Aucune donnée en mémoire pour find_garages

— Démarrage collecte

Collecte initiée pour find_garages: required=[‘location’, ‘max_distance_km’]

— Context extraction for ‘location’: NOT_FOUND

find_garages — mais ne l’exécute pas encore. La donnée de localisation est manquante. Avant d’aller plus loin, le système demande. C’est du consentement actif, déclenché par l’état émotionnel.Le moteur ne demande pas parce qu’une règle l’y oblige.

Il demande parce que l’utilisateur est émotionnellement prêt à répondre oui.

L’arc émotionnel complet de la conversation

En trois échanges, le moteur a traversé quatre états distincts et pris des décisions différentes à chaque étape.

find_garages. Collecte de localisation.

Les 24 dyades : ce que le moteur écoute en permanence

Le modèle psychoévolutionnaire de Plutchik identifie 8 émotions primaires. En combinaison, elles génèrent 24 dyades distinctes — chacune avec sa propre signature émotionnelle, sa valence et ses implications comportementales. Le moteur ConsentPlace surveille les 24, en continu, à chaque tour de conversation.

Dans cette démo, Espoir puis Optimisme se sont activés en séquence. Dans une autre conversation — même marque, utilisateur différent — Remords ou Cynisme pourraient dominer. Chaque dyade déclenche un playbook différent. Chaque playbook adapte le ton, le rythme, le cadrage du CTA et la stratégie de next move en conséquence.

Chaque signal que le flux remonte

| Signal | Ce qu’il mesure | Action déclenchée |

|---|---|---|

| primary_emotion | Émotion dominante détectée dans le message | Routage initial du playbook |

| secondary_emotion | Émotion combinée formant une dyade | Activation de la dyade, playbook approfondi |

| dyad_name | État émotionnel nommé (ex. Espoir, Remords) | Stratégie de réponse spécifique déverrouillée |

| valence | Orientation positive/négative (–1 à +1) | Calibrage du ton |

| arousal | Intensité de l’engagement émotionnel (0 à 1) | Ajustement du rythme et de l’urgence |

| dynamic_pattern | Single, reinforcement, conflict ou transition | Gestion de l’arc conversationnel |

| Analyse opportunité consentement | Moment optimal pour demander une action | Déclenchement de la collecte GDPR-native |

| Dynamics Adaptation | Instruction ton + rythme en temps réel | Changement de comportement immédiat de l’assistant |

La transparence comme avantage concurrentiel

Tous les assistants IA s’adaptent. La plupart s’adaptent de façon invisible, selon des heuristiques que personne ne peut inspecter ni valider.

ConsentPlace rend l’adaptation visible — non seulement dans les métriques du Dashboard (LDP, ICE, TTD), mais dans la couche de signal brut elle-même. Le Flux Console Brut est une preuve de travail : chaque adaptation de l’assistant est traçable jusqu’à un signal émotionnel précis, une dyade précise, une décision de playbook précise.

Cela compte pour les acheteurs enterprise et les équipes conformité qui ont besoin de comprendre — et d’auditer — le comportement de leur IA avec leurs clients. Cela compte pour les responsables de marque qui doivent savoir si la relation émotionnelle avec leurs utilisateurs se renforce ou s’érode. Et cela compte pour quiconque s’est déjà demandé ce qu’une IA fait réellement quand elle décide de changer de ton en milieu de conversation.

L’assistant ne devine pas. Il lit. Et le flux vous montre exactement ce qu’il a lu.

Voyez le flux en direct

Le Flux Console Brut est accessible dans la démo ConsentPlace en ligne — sans inscription, sans configuration. Ouvrez la démo, cliquez sur le bouton >_ en haut à droite de l’interface, et observez le moteur travailler en temps réel.

Changez de persona. Changez de contexte d’arrivée. Regardez comment le flux évolue — à quelle vitesse une dyade se forme, comment le routage du playbook bascule, comment l’adaptation du ton répond à un seul mot d’enthousiasme ou de frustration dans le message de l’utilisateur.

Ce n’est pas une visualisation construite pour l’effet. C’est la couche de signal réelle sur laquelle tourne le moteur de Dynamiques Émotionnelles.

La conversation est en surface.

L’intelligence est dans le flux.

Ouvrez la démo et cliquez sur >_ pour le constater par vous-même.

Ouvrir le Dashboard → Démo complète Contactez-nous !Références & Sources

- Plutchik, R. (1980) — « A general psychoevolutionary theory of emotion »

- Plutchik, R. (2001) — « The Nature of Emotions. » American Scientist, 89(4), 344–350

- Comment mesurer le ROI des Dynamiques Émotionnelles : les 3 métriques essentielles — Blog ConsentPlace, mars 2026

- ConsentPlace — Dashboard de Dynamiques Émotionnelles (démo)